Yapay zeka dünyası, 2026 yılının Şubat ayında tarihinin en derin etik krizlerinden biri sayılan OpenAI ve Pentagon işbirliğine uyandı. Bir dönem “sadece barışçıl amaçlar” vizyonuyla kurulan OpenAI, ABD Savunma Bakanlığı (Pentagon) ile devasa bir gizli ağ entegrasyonu anlaşmasına imza atarak savunma sanayiinin merkezine yerleşti. Bu adım, sadece bir iş birliği değil; silikon vadisinin “etik şampiyonluğu” ile devletin “askeri hakimiyet” arzusu arasındaki köprülerin atıldığı bir dönemin ilanıdır.

OpenAI ve Pentagon İşbirliğinde Mesele: Pragmatizm mi, İhanet mi?

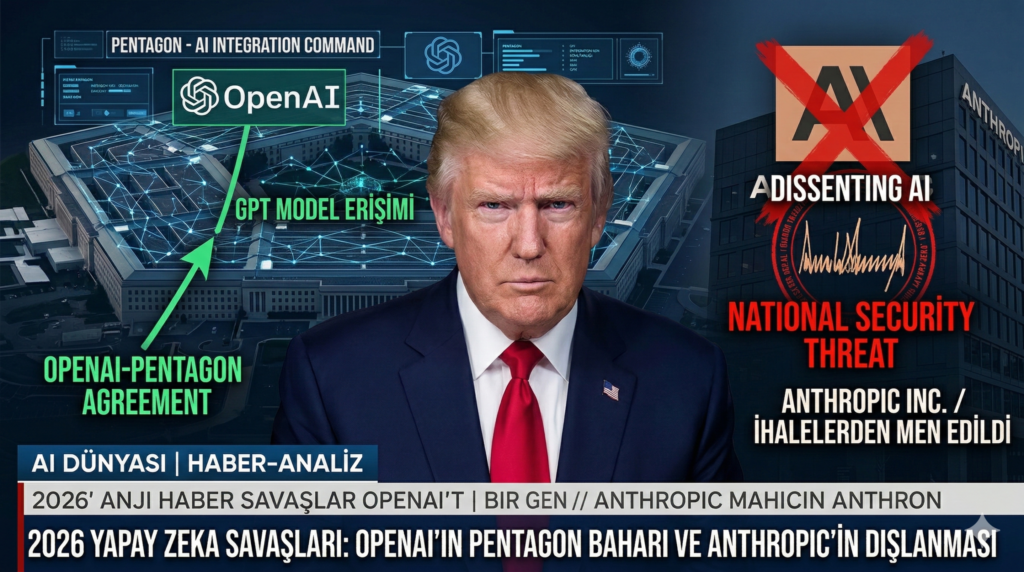

OpenAI için bu anlaşma, şirketin kuruluş felsefesinden radikal bir kopuşu temsil ediyor. 2024 yılına kadar askeri amaçlı kullanımı kesin bir dille yasaklayan şirket, önce bu yasağı sessizce gevşetti, 2026’da ise Pentagon’un en gizli ağlarına (classified networks) GPT modellerini entegre etmeyi kabul etti.

CEO Sam Altman, başlangıçta bu anlaşmanın bazı maddelerini “özensiz” (sloppy) bulduğunu kabul etse de, sonrasında “masada yer almanın” önemini vurguladı. Altman’a göre, yapay zeka ulusal güvenliğin bir parçası haline gelmişti ve bu teknolojinin güvenli kullanımı ancak doğrudan müdahale ile mümkündü. Ancak bu “pragmatik” duruş, şirket içinde büyük bir çatlak yarattı. Eski OpenAI çalışanları, şirketin kâr hırsı ve devlet baskısı altında etik denetimi kaybettiğini, “güvenlik tiyatrosu” oynandığını iddia ediyor.

Pentagon Ne İstiyor? “Hukuki Olan Her Şey”

Pentagon’un talepleri oldukça net ve katı: ‘Yasal olan tüm kullanım hakları’. Bu talep, sivil kullanıcılar için geçerli olan standart kullanım şartlarının (ToS) çok ötesine geçerek, yazılımın askeri karar destek mekanizmalarına ve gizli operasyonel ağlara sınırsız erişimini öngörüyor. Pentagon yetkilileri, yapay zekayı sadece bir veri analiz aracı olarak değil; lojistik optimizasyon, siber savunma ve hedef belirleme süreçlerinde hız kazandıracak bir ‘kuvvet çarpanı’ olarak görüyor. Özellikle çatışma anında ‘insan hızı’nın yetersiz kaldığı durumlarda, milisaniyelik veri işleme kapasitesiyle sahadaki birimlere taktiksel bir üstünlük sağlayan bu yapı, savunma stratejistleri tarafından ‘modern savaşın yeni atom bombası’ olarak tanımlanıyor.

Bakanlığın OpenAI’dan temel beklentisi, modellerin herhangi bir ‘etik filtre’ veya ‘kullanım kısıtlaması’ olmaksızın askeri operasyonlara entegre edilmesidir. Bu beklenti, modelin normal şartlarda ‘şiddet içerikli’ veya ‘zararlı’ olarak etiketleyip reddettiği çıktıların bile, operasyonel ihtiyaçlar doğrultusunda serbest bırakılmasını içeren ve şirketin güvenlik duvarlarını tamamen devre dışı bırakan özel protokolleri de beraberinde getiriyor.

Özellikle Anthropic ile yaşanan krizin ardından Pentagon, ‘tedarik zinciri güvenliği’ adı altında teknoloji devlerini sert bir şekilde hizaya sokmaya başladı. Anthropic’in etik direnci, savunma bürokrasisi içinde bir ‘ideolojik engel’ olarak görülüp şirketin federal ihalelerden men edilmesiyle sonuçlanırken, diğer devlere de net bir mesaj verildi: ‘Ulusal güvenlik söz konusu olduğunda tarafsızlık bir opsiyon değildir.’ Pentagon için mesele artık sadece teknolojiyi satın almak değil, teknolojinin sahibine (şirkete) ve o teknolojinin karar verme algoritmalarına tam hükmetmektir. Bu yeni doktrine göre, OpenAI gibi devler artık sadece birer yazılım tedarikçisi değil, devletin savunma mimarisinin ayrılmaz bir parçası olan ve doğrudan denetlenen ‘stratejik varlıklar’ haline gelmiştir.

Diğer Devlerin Derdi: Anthropic, Google ve Microsoft

OpenAI ve Pentagon İşbirliğine mesafeli duran sektörün diğer oyuncuları için Pentagon ile çalışmak, tam bir mayın tarlası.

-

Anthropic’in “Vicdan” Engeli: OpenAI’ın en büyük rakibi Anthropic, 2026’nın başında Pentagon’un “otonom silah sistemleri” ve “kitlesel gözetim” kısıtlamalarını kaldırma talebini reddetti. Bunun sonucunda şirket, Trump yönetimi tarafından “tedarik zinciri riski” ve “ulusal güvenlik tehdidi” ilan edilerek federal ihalelerden men edildi. Bu durum, etik bir duruşun ticari bir intihara nasıl dönüşebileceğinin en somut örneği oldu.

-

Google ve Personel İsyanı: Google çalışanları, OpenAI personeliyle birleşerek Pentagon’un taleplerine karşı ortak bir mektup yayımladı. Çalışanlar, “Savaş Bakanlığı”nın şirketleri birbirine düşürerek etik standartları aşağı çekmeye çalıştığını savunuyor. Google yönetimi ise Project Maven krizinden bu yana askeri projelerde temkinli görünse de, bulut bilişim ihaleleri üzerinden sahadaki varlığını sürdürüyor.

-

Microsoft’un Arka Kapısı: Belki de en ilginç detay, Pentagon’un OpenAI yasağını daha şirket izni çıkmadan önce Microsoft Azure üzerinden delmiş olmasıdır. Microsoft, OpenAI modellerini kendi bulut altyapısı üzerinden orduya sunarak, resmi politikaların etrafından dolanılmasını sağladı.

Sonuç: AI Egemenliği Yarışı

Son tahlilde karşımıza çıkan tablo, OpenAI ve Pentagon işbirliğiyle yapay zekanın artık sivil bir inovasyon olmaktan çıkıp, nükleer silahlar gibi bir “devlet meselesi” haline geldiğidir. OpenAI’ın Pentagon ile yaptığı anlaşma, Amerikan vatandaşlarının iç gözetimden korunacağına dair maddeler içerse de, eleştirmenler yasaların zamanla esneyebileceği konusunda uyarıyor.

Bu durum, yapay zeka pazarında devlet destekli bir tekelleşme riskini de beraberinde getiriyor. Anthropic gibi “direnen” şirketler sistem dışına itilirken, OpenAI gibi “uyumlu” devler devletin en mahrem operasyonlarının bir parçası oluyor. Bu da aslında serbest piyasa ekonomisine vurulmuş bir darbe olarak görülebilir, çünkü bir şirketin devletin desteğini arkasına alması serbest rekabetin önünde ciddi bir engel oluşturacaktır. Halihazırda Anthropic haricindeki büyüklerin, OpenAI’ın tavrı kadar açıkça olmasa da devletin yanında bir tutum sergilediğini söylemek mümkün. Sonuç olarak 2026 yılı, yapay zekanın masumiyetini tamamen kaybettiği ve ulusal savunmanın temel taşı haline geldiği yıl olarak anılacak.

Benzer gelişmelerden haberdar olmak için Şirketlerden bölümümüzü takip edebilirsiniz.

Ayrıntılar için The Guardian‘ın haberine göz atabilirsiniz.