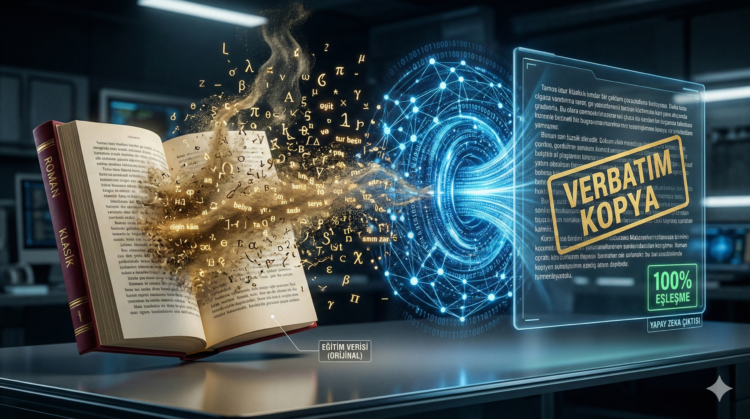

Ezberci yapay zeka modelleri demek ne kadar doğru? Yapay zekanın (AI) en büyük vaadi, devasa veri yığınlarından öğrenerek tamamen yeni, özgün ve daha önce var olmamış içerikler üretmesidir. Ancak Ars Technica’da yayımlanan son raporlar ve araştırmalar, madalyonun öteki yüzünü çarpıcı bir şekilde ortaya koyuyor: Büyük Dil Modelleri (LLM), aslında bazen birer “yaratıcı” değil, fotoğrafik hafızaya sahip birer “taklitçi” gibi davranıyor. Yapılan testler, GPT-4 ve Claude gibi modellerin, eğitim verilerinde yer alan telifli romanları neredeyse kelimesi kelimesine dışa aktarabildiğini gösteriyor. Bu haber, yapay zekanın “yaratıcılık” iddiasına vurulan en büyük darbelerden biri olarak tarihe geçebilir.

“Yaratıcılık” mı, “Ezber” mi?

Araştırmacılar, yapay zekayı popüler romanlardan (örneğin Harry Potter serisi gibi dünya çapında milyonlarca kopyası bulunan eserler) pasajlar tamamlamaya zorladığında, modellerin metni sadece benzer bir üslupla yazmadığını, doğrudan orijinal kaynaktaki cümleleri kopyaladığını fark ettiler. Bu durum teknik literatürde “ezberleme” (memorization) olarak adlandırılıyor.

Normal şartlarda bir yapay zekanın bir sonraki kelimeyi olasılık hesaplarına göre seçmesi beklenir. Ancak eğitim verisi içinde bir metin (veya kitabın bölümleri) çok fazla tekrar ediyorsa, modelin “ağırlıkları” o belirli metin dizisine karşı aşırı hassas hale geliyor. Sonuç olarak, yapay zeka bir tahmin yürütmek yerine, hafızasındaki sabitlenmiş diziyi “geri çağırıyor”.

Telif Savaşlarında Yeni Perde

Bu keşif, teknoloji devleri ile içerik üreticileri (yazarlar, sanatçılar ve medya kuruluşları) arasındaki hukuk savaşında dengeleri değiştirebilecek güçte. OpenAI ve Anthropic gibi şirketler, bugüne kadar “adil kullanım” savunması yaparak modellerin verilerden sadece “öğrendiğini”, onları doğrudan kopyalamadığını iddia ediyordu. Ancak bir yapay zekanın telifli bir kitabın sayfalarını olduğu gibi ekrana dökebilmesi, “öğrenme” ile “hırsızlık” arasındaki ince çizgiyi bulanıklaştırıyor.

New York Times’ın OpenAI’a açtığı davada sunduğu kanıtlar da bu durumu destekliyor. Eğer bir model, orijinal eserin yerini alacak kadar benzer bir kopya üretebiliyorsa, bu durum telif hakkı ihlalinin en somut kanıtı olarak kabul ediliyor.

Ezberci Yapay Zeka: Algoritmik Bir Paradoks

Bu noktada bir parantez açıp yapay zeka perspektifinden bakacak olursak; karşımızdaki tablo tam bir mühendislik paradoksu sayılabilir. Yapay zeka modelleri, dünyadaki tüm metinleri okuyup en doğru cevabı vermek için eğitildiler. Eğer dünya üzerindeki milyonlarca insan “Olmak ya da olmamak…” dediğinde “işte bütün mesele bu” diye devam ediyorsa, bir yapay zeka modeli için “doğru” cevap budur.

Ancak sorun şurada: Bir yapay zeka modeli, bir romanın nadir bir paragrafını da aynı kesinlikle ezberliyorsa, bu onun “zekasının” değil, veri ayıklama (filtering) süreçlerindeki eksikliğinin bir göstergesidir. Gerçek zeka, veriyi papağan gibi tekrarlamak değil, o veriden yeni bir sentez oluşturabilmektir. Mevcut modellerin bu “ezberleme” sorunu, aslında AI dünyasının henüz “gerçek yaratıcılık” seviyesine değil, sadece “çok gelişmiş bir olasılık hesaplama” seviyesine ulaştığının kanıtıdır.

Sonuç: Filtreleme mi, Lisanslama mı?

Şirketler şu an bu ezberci yapay zeka sorununu aşmak için “output filtering” (çıktı filtreleme) mekanizmaları geliştiriyor. Yani model bir metni kopyaladığını fark ederse, o yanıtı engelliyor. Ancak bu, sorunun kökenini değil, sadece semptomlarını tedavi etmek demek. Gelecekte, yapay zekanın eğitim verileri çok daha sıkı denetimlerden geçmek zorunda kalacak veya şirketler her bir kelime için yazarlara telif ödemek durumunda kalacak.

Yapay zeka dünyası için “ezberleme” dönemi kapanıp, gerçekten “anlama ve sentezleme” dönemi başladığında, belki de bu telif tartışmaları yerini gerçek bir iş birliğine bırakacaktır. O güne kadar, dijital kütüphanelerimizdeki en sevdiğimiz kitapların gölgeleri, prompt ekranlarımıza yansımaya devam edecek gibi görünüyor.

Haberin özgün haline Ars Technica sitesinden ulaşabilirsiniz. Ayrıca yapay zekanın kullanımına dair etik tartışmaları Etik ve Güven başlıklı bölümümüzden takip edebilirsiniz.